"Werden meine Daten jetzt zum Training benutzt?" Diese Frage stellen sich immer mehr Menschen, die KI-Tools im Berufsalltag nutzen. Die Antwort hängt davon ab, wie und wo Sie die KI einsetzen. Wir erklären den Unterschied.

ChatGPT, Claude und Gemini sind aus dem Arbeitsalltag vieler Unternehmen kaum noch wegzudenken. Doch wenn Mitarbeitende anfangen, Kundendaten, Vertragsdetails oder interne Berichte in Chatfenster einzutippen, entsteht eine berechtigte Frage: Wo landen diese Informationen und könnte die KI sie fürs Training verwenden? Die gute Nachricht: Für Unternehmen, die KI über professionelle Zugänge nutzen, gibt es klare vertragliche Antworten. Die schlechte Nachricht: Wer einfach die kostenlose Webseite öffnet, bewegt sich auf dünnem Eis.

Hinweis: Dieser Artikel stellt keine Rechtsberatung dar und kann eine individuelle juristische Prüfung nicht ersetzen.

Wie KI-Modelle lernen und welche Rolle Ihre Daten spielen

Große Sprachmodelle wie ChatGPT (OpenAI), Claude (Anthropic) oder Gemini (Google) wurden auf riesigen Textmengen trainiert. Das initiale Training der Basis-Modelle ist weitgehend abgeschlossen und es gibt einen Knowledge-Cutoff ab einem gewissen Zeitpunkt. Aber Anbieter optimieren ihre Modelle laufend weiter und die Frage ist: Fließen dafür auch Gespräche von Nutzerinnen und Nutzern ein?

Ob das passiert, hängt nicht vom Modell ab, sondern vom Vertrag, den Sie mit dem Anbieter haben.

Private Nutzung von KI: Was passiert mit Daten im kostenlosen Chatfenster?

Wer ChatGPT, Claude oder Gemini über die öffentliche Webseite nutzt, stimmt den Consumer Nutzungsbedingungen zu. Diese sehen häufig vor, dass Konversationsdaten zur Modellverbesserung genutzt werden dürfen.

Datenschutz bei ChatGPT (OpenAI):

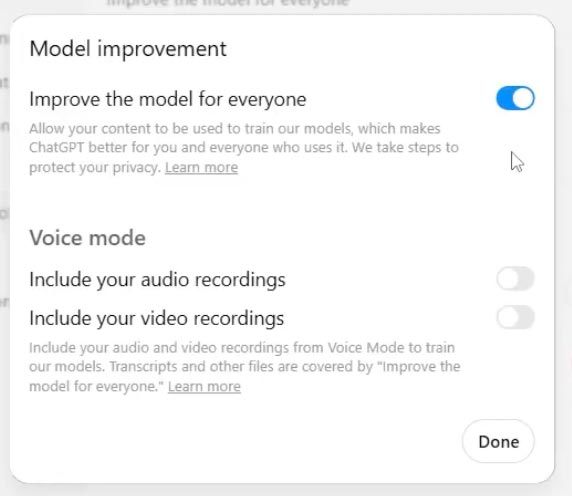

OpenAI nutzt in der kostenlosen Version Gespräche standardmäßig für Trainingszwecke. Ein Opt-out ist in den Einstellungen möglich, muss aber aktiv aktiviert werden (siehe Screenshot). Wer sensible Unternehmensdaten in die kostenlose ChatGPT-Oberfläche eingibt, riskiert gegebenfalls, dass diese Daten in zukünftige Modellversionen einfließen.

Datenschutz bei Claude (Anthropic)

Bei Claude gelten die Consumer Terms of Service. Anthropic kann hier Daten zur Modellverbesserung nutzen, sofern Nutzerinnen und Nutzer dem nicht widersprechen. Für den Unternehmenseinsatz gibt es eine klare Ausnahme. Dazu gleich mehr.

Datenschutz bei Gemini (Google)

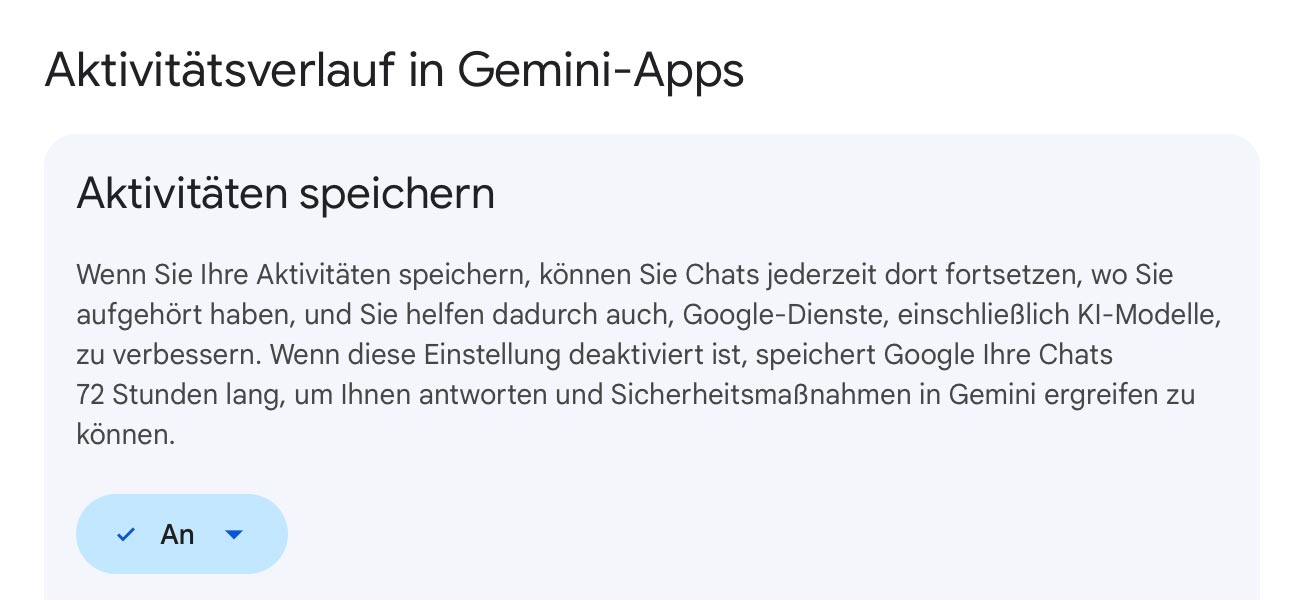

Google nutzt bei Gemini-Gesprächen über Google-Konten unter Umständen Daten für die Produktverbesserung. Wie genau das gehandhabt wird, hängt von den Account-Einstellungen und dem verwendeten Tarif ab. Auffällig: Wer historische Chats länger als 72 Stunden behalten möchte, muss der Speicherung und potenziellem Review zustimmen.

Kurzfassung: Bei der kostenlosen, privaten Nutzung aller drei Anbieter ist Vorsicht geboten, wenn esum vertrauliche Informationen geht.

Professionelle Nutzung: Was die API wirklich garantiert

Unternehmen, die KI-Modelle über eine API (Application Programming Interface) in ihre Prozesse integrieren, schließen Verträge unter professionellen Nutzungsbedingungen ab. Hier gilt eine andere Rechtslage.

Datenschutz bei ChatGPT API / Enterprise (OpenAI)

OpenAI bietet ebenfalls API- und Enterprise-Zugänge an, bei denen Daten nicht für das Training genutzt werden. Voraussetzung: Abschluss eines Auftragsverarbeitungsvertrags (AVV) mit OpenAI Ireland als Vertragspartner für EU-Kunden. Auch in ChatGPT Team-Lizenzen wird explizit gesagt, dass nicht mit Gesprächen aus dem Account trainiert wird. Eine weitere Alternative ist die Nutzung über das Microsoft Azure Hosting auf EU-Servern.

Quelle: Enterprise-Datenschutz bei OpenAI

Datenschutz bei Claude API – Anthropic Commercial Terms:

Die Anthropic Commercial Terms of Service enthalten eindeutige Vertragsklauseln die besagen, dass Anthropic es vertraglich untersagt ist, Kundeninhalte aus der API-Nutzung für das Training von KI-Modellen zu verwenden. Das bedeutet konkret: Alles, was über die API übermittelt wird – Eingaben (Inputs) wie Ausgaben (Outputs) – ist als vertrauliche Information eingestuft. Anthropic darf diese Daten ausschließlich zur Erbringung des vereinbarten Dienstes nutzen. Zugriff intern nur nach dem Need-to-know-Prinzip.

Quelle: Anthropic Commercial Terms of Service

Datenschutz bei Gemini for Google Workspace / Gemini API

Im Workspace-Kontext (z. B. Gemini in Google Docs für Unternehmenskunden) gilt: Daten werden nicht für das Training generativer Modelle genutzt. Google unterzeichnet ebenfalls Auftragsverarbeitungsverträge.

Was bedeutet das für Unternehmen?

Ob KI mit Ihren Daten trainiert oder nicht, ist keine technische Frage, es ist eine Vertragsfrage. Hier die wichtigsten Schlussfolgerungen:

- Professionelle API-Zugänge sind die sichere Wahl: Alle großen Anbieter garantieren bei API und Enterprise-Nutzung vertraglich, dass keine Trainingsdaten aus Kundeneingaben entstehen.

- Kostenlose Web-Versionen sind kein Unternehmenstool: Wer dort sensible Informationen eingibt, bewegt sich in einer rechtlich unklaren Zone und riskiert Verstöße gegen interne Richtlinien oder die DSGVO.

- Auftragsverarbeitungsvertrag (AVV) ist Pflicht: Sobald Sie personenbezogene Daten in KISysteme eingeben, brauchen Sie einen AVV. Alle genannten Anbieter stellen diesen für ihre professionellen Zugänge bereit.

- Physische Datenresidenz bleibt ein Thema: Auch ohne Modelltraining: Daten verlassen bei US-Anbietern physisch die EU. Wer das vermeiden will, braucht eine EU-Lösung oder lokale Modelle.

Für den praktischen Einstieg empfehlen wir, KI-Zugänge für Teams über sichere, zentral verwaltete Plattformen bereitzustellen. Wie das konkret aussehen kann, haben wir in unserem Artikel zu Langdock und DSGVO-konformer KI-Nutzung beschrieben.

Fazit

Die Frage, ob KI mit meinen Daten trainiert, lässt sich nicht pauschal beantworten. Sie hängt vom Zugang ab, nicht vom Modell. Wer ChatGPT, Claude oder Gemini über die öffentliche Webseite nutzt und dabei vertrauliche Informationen eingibt, geht ein reales Risiko ein. Wer dagegen auf professionelle API-Zugänge oder Enterprise-Lizenzen setzt und einen AVV abschließt, hat klare vertragliche Garantien auf seiner Seite.

Für Unternehmen gilt: Nicht das Tool entscheidet über die Datensicherheit sondern der Vertrag dahinter. Und der lässt sich mit den richtigen Zugängen sehr gut gestalten.